第十九届中国图象图形学学会青年科学家会议

多模态计算论坛成功举办

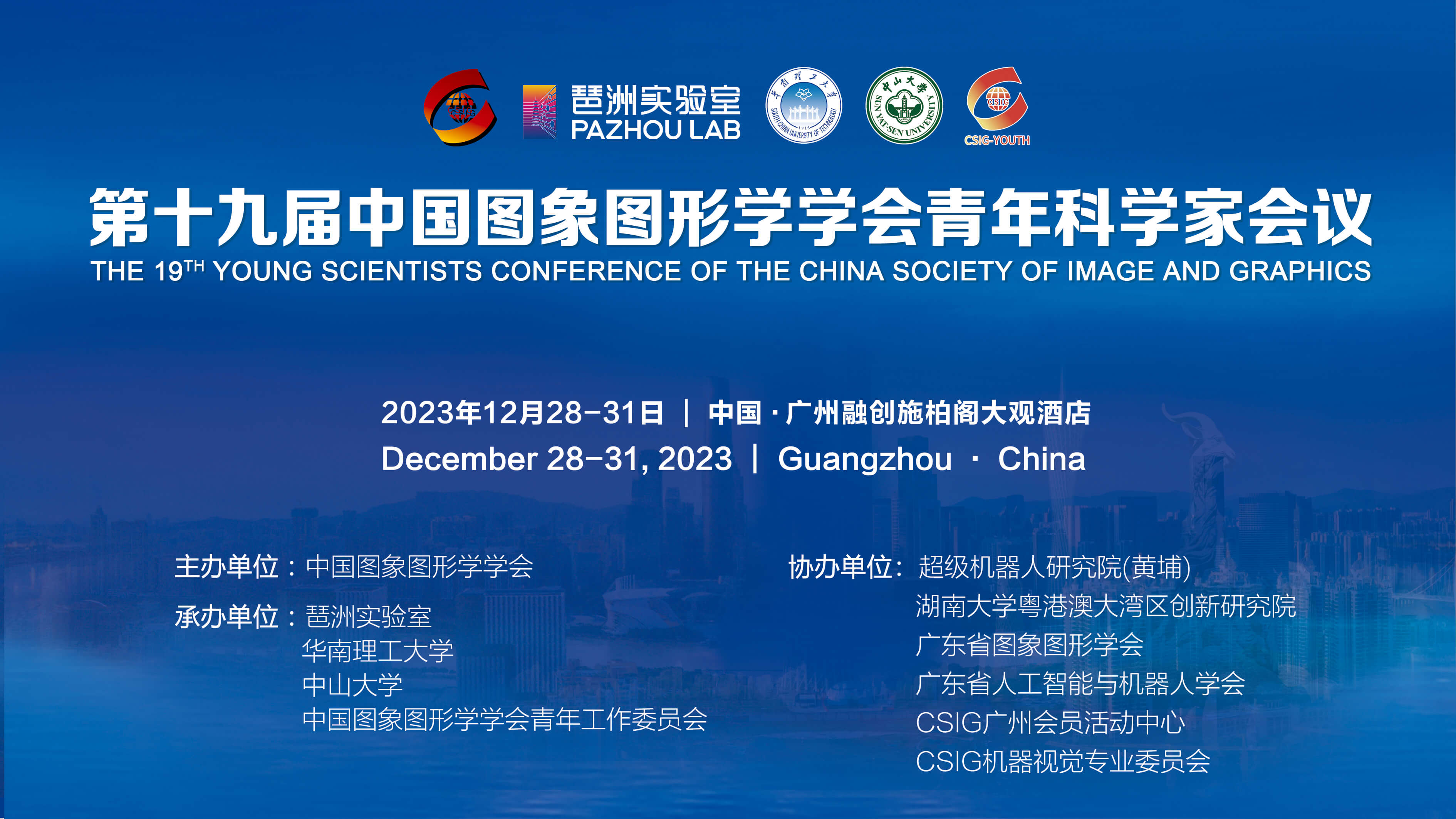

由中国图象图形学学会青年工作委员会发起的“第十九届中国图象图形学学会青年科学家会议”于2023年12月28-31日在中国广州召开。本次会议由中国图象图形学学会主办,琶洲实验室、华南理工大学、中山大学、中国图象图形学学会青年工作委员会承办。王耀南院士、谭铁牛院士、中山大学赖剑煌教授、华南理工大学徐向民副校长、许勇副校长、琶洲实验室常务副主任李远清教授、华南理工大学陈俊龙教授、北京大学林宙辰教授共同担任大会主席。

会议面向国际学术前沿与国家战略需求,聚焦最新前沿技术和热点领域,会议设4个大会报告,27个主题分论坛,4个Tutorial,总计近150场高水平学术报告 。2023年12月29日上午, 多模态计算论坛成功举办。论坛由梁小丹、常晓军、朱磊联合组织。“多模态计算”是当今备受瞩目的研究领域,其在人机交互、无障碍技术、情感计算、社交媒体和社交网络、自动驾驶和智能交通、医疗和健康监测、安防和监控等多个领域发挥着重要作用。论坛聚焦该领域的最新研究进展与前沿技术,详细探讨了“多模态预训练模型的构建与应用”和“多维感知驱动的AIGC”等主题内容。

杭州电子科技大学教授俞俊、中国人民大学高瓴人工智能学院教授卢志武、电子科技大学教授宋井宽、华为诺亚方舟实验室技术专家徐航几位专家,作为本场论坛讲者进行主题报告。

杭州电子科技大学教授俞俊带来主题为“基于Transformer框架的多模态学习”的报告。

使用深度神经网络对视觉、语言等不同模态信息进行统一建模的多模态深度学习是近年来的研究热点,在跨媒体检索、视觉内容描述、视觉问答等典型的多模态深度学习任务上均取得了显著的进展。得益于深度自注意力网络模型Transformer和预训练方法BERT在自然语言领域的快速发展,多模态深度学习的研究逐渐由各个任务“分而治之”向“通用统一”的方向演变,即使用单个框架适配多种类型不同的多模态任务。本报告首先对多模态深度学习发展过程中的代表性工作进行简要介绍;然后对当前基于Transformer框架的多模态深度学习领域的三类代表性方法:基于多模态多任务联合学习、多模态神经架构搜索、多模态预训练的若干代表性工作进行详细介绍;最后,对通用多模态深度学习未来的发展进行展望和反思。

北京大学教授彭宇新带来主题为“多维感知驱动的AIGC”的报告。

AIGC(Artificial Intelligence Generated Content)是指人工智能自动生成并创造新内容的生产方式。随着人工智能的迅速发展,AIGC从主要生成文本内容到如今已可以根据用户给定的文本描述自动生成语义一致、内容真实且符合逻辑的图像、视频等视觉内容。这是人工智能从“感知智能”迈向“认知智能”的一项重要任务,在教育、设计、影视、创作等领域具有重要的应用价值。当前以扩散模型为代表的生成模型已经可以根据文本描述生成高质量的视觉内容,但在精细化控制和高维信息建模上仍存在不足。其关键科学问题是如何准确地感知和建模图像视频等视觉内容中的局部细节、空间布局和时序动作等多维时空信息,实现视觉内容的可控精细生成。本报告将介绍我们在文本到视觉内容生成的近期工作进展,包括细节可控的图像生成、时序运动连贯的视频生成等,并对未来发展方向及趋势进行简要讨论与展望。

中国科学院自动化研究所研究员徐常胜带来主题为“视频理解中的关系学习研究”的报告。

随着便携式数码设备的普及和移动互联网的发展,海量的视频大数据亟需智能的视频理解技术。视频理解是一个融合视频底层特征信息和高层语义信息的过程,并服务于用户的不同需求。高效的视频理解技术可以使计算机智能地完成各种视频相关的任务,如视频监控、视频娱乐等。视频大数据具有(1)时空复杂,(2)底层特征与高层语义之间存在“语义鸿沟”,(3)类别丰富,(4)多模态,(5)个性化需求多样等特点。这些特点在视频数据中表现为纷繁复杂的关系信息,因此为视频的智能理解带来了巨大的挑战。事实上,针对视频中复杂而多样的关系模式进行学习对深入地理解视频内容是至关重要的。本报告围绕如何设计有效的关系学习方法来进行视频理解展开,自底向上地重点研究了视频中的三种关系结构信息:首先针对视频中的物体层面,研究了物体表观中的结构化关系建模;接着以物体为纽带,深入挖掘了视频中的物体-语义关系信息,从而实现了视频高层语义的自动提取;最后,探索了视频语义-用户兴趣之间的关系,完成了视频的个性化服务。

中国人民大学高瓴人工智能学院教授卢志武带来主题为“多模态通用生成模型的基本框架与最新进展”的报告。

多态预训练在过去三年得到飞速的发展,涌现出OpenAI CLIP、Stable Diffusion、GPT-4V等优秀模型。受GPT-4V的启发,多模态预训练出现新的变化,开始更关注多模态通用生成。本报告首先给出多模态通用生成模型的定义与基本框架。然后从语言生成和视频生成两个方面展开,详细介绍我们的最新研究进展。最后还会介绍我们在落地应用上的初步探索。

电子科技大学教授宋井宽带来主题为“多媒体紧致表征与分析”的报告。

在当今的大数据时代,多媒体系统已成为了至关重要的基础设施。随着AIGC技术取得显著突破,多媒体数据在数以亿万级地不断产生着。如此庞大的数据规模使得多媒体系统在进行任何数据处理时,都将产生巨大的资源消耗。因此,研究者尝试通过多媒体紧致表征来解决上述困境。这一技术将原始数据压缩为简短的二值化编码,通过硬件加速方法,上述处理的空间和时间复杂度都得到了显著下降。由于种种优势,它已在很多场景中得到应用,并得到了长期关注。本次报告将围绕这一方法的两种主要技术:哈希和量化,对多媒体紧致表征中的经典算法和最新进展进行简要介绍。紧接着,还将介绍多媒体紧致表征在三种场景中的应用,包括快速检索、视觉压缩和模型压缩等。在上述场景中,本报告根据不同任务设计,介绍针对紧致表征“如何保留关键信息”、“如何实现离散优化”两类核心问题。

华为诺亚方舟实验室技术专家徐航带来主题为“文本导向的多模态生成的一些探索和实践”的报告。

“数字创作与技术融合的今天,文本导向的多模态生成技术逐渐崭露头角。深度扩散生成模型为跨模态生成提供了强大的工具,使图片、视频、3D模型等内容的生成更为高效和可控。本讲座将详细探讨此技术的关键研究进展,包括任意尺寸的图片生成、可控图片生成、长视频生成及ID保持的3D模型生成等。报告分享本研究组在这些AIGC方向上的最新研究成果,为大家展现这一领域的技术前沿和未来潜力。

本次论坛为青年科学家们提供了宝贵的学术交流平台,为多模态计算的研究进展提供了新的启示和思想碰撞。