第十九届中国图象图形学学会青年科学家会议

通用与视觉大模型论坛成功举办

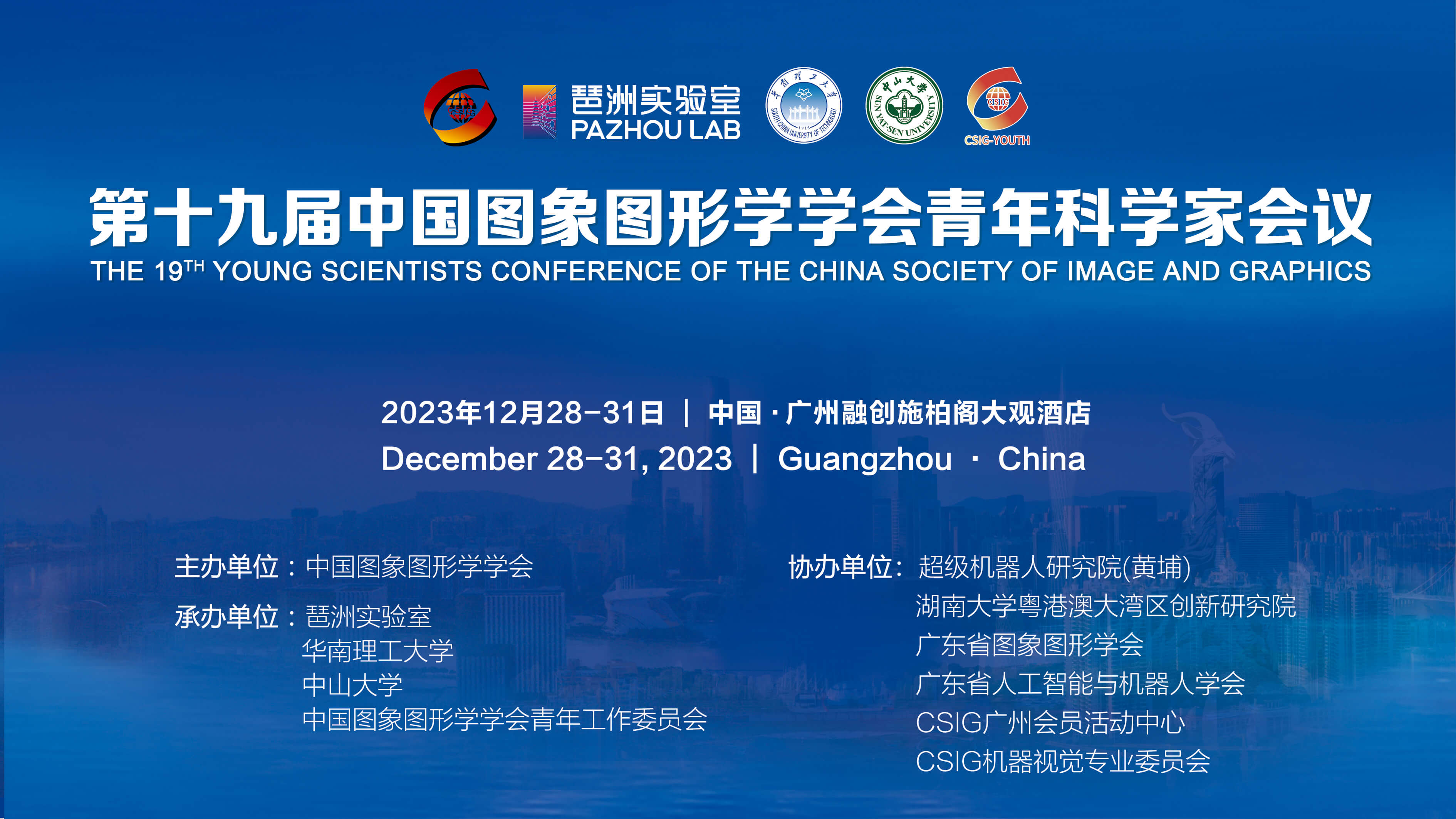

由中国图象图形学学会青年工作委员会发起的“第十九届中国图象图形学学会青年科学家会议”于2023年12月28-31日在中国广州召开。本次会议由中国图象图形学学会主办,琶洲实验室、华南理工大学、中山大学、中国图象图形学学会青年工作委员会承办。王耀南院士、谭铁牛院士、中山大学赖剑煌教授、华南理工大学徐向民副校长、许勇副校长、琶洲实验室常务副主任李远清教授、华南理工大学陈俊龙教授、北京大学林宙辰教授共同担任大会主席。

会议面向国际学术前沿与国家战略需求,聚焦最新前沿技术和热点领域,会议设4个大会报告,27个主题分论坛,4个Tutorial,总计近150场高水平学术报告 。2023年12月30日上午,通用与视觉大模型论坛成功举办。论坛由贾伟教授、谭明奎教授、谢凌曦老师、代季峰教授和王鑫龙老师联合组织,贾伟教授和吴庆耀教授担任本次论坛主持人。“通用视觉大模型”是重要的前沿科技领域,其着重于提升视觉大模型的通用性,构造多媒体、一体化的通用大模型。论坛聚焦该领域的最新研究进展与前沿技术,详细探讨了“大模型的科学挑战”、“ 大语言模型技术的研发与思考”、“ 视觉大模型:实践和思考”、“ 从视觉到多模态基础模型”、“ 面向交通行业的佳都知行多模态大模型TransCore-M”、“ 基于国产算力的鹏城·大圣系列基础模型及其应用”等主题内容。

复旦大学教授邱锡鹏、中国人民大学教授赵鑫、鹏城实验室研究员王耀威、清华大学副教授代季峰、北京智源人工智能研究员视觉模型研究中心负责人王鑫龙、百度视觉技术部主任架构师和佳都科技集团股份有限公司首席AI科学家王凯七位专家,作为本场论坛讲者进行主题报告。

邱锡鹏教授带来主题为“大模型的科学挑战”的报告。

大模型在人工智能多个领域显示出极强的通用性,极大地推动了下游任务上的性能提升。但是,但是大模型依然存在很多科学挑战,包括模型的架构、推理能力来源、幻觉、可解释性等问题。本报告主要介绍大模型的主要科学挑战以及对未来研究的展望。

赵鑫教授的报告主题为“大语言模型技术的研发与思考”。

近年来,以ChatGPT为代表的大语言模型受到了社会的广泛关注。本次报告将围绕大语言模型研发过程中的关键技术展开介绍,将从预训练、指令微调、人类对齐、落地、评测等方面展开讨论,分析现有技术特点以及局限之处,并且展望未来大语言模型的发展趋势。

代季峰副教授的报告主题为“开放任务下的视觉通用解码器网络”。

代季峰教授讲解了大型语言模型(LLM)如何带来生产力的变革,特别是它的应用边际成本较低。他强调了LLM在减少特定任务模型微调需求方面的优势,表明这可以显著降低成本。在演讲的PPT中,代教授还用边际成本的概念来进一步说明,在增加生产量时,单位成本的降低潜力。

王鑫龙博士的报告主题为“从视觉到多模态基础模型”。

语言基础模型率先取得突破,如何构建通用的视觉和多模态基础模型,成为现在视觉领域关注的热点问题。本次报告将围绕视觉上下文学习、大规模图文对比学习、生成式多模态预训练等前沿技术,介绍大规模视觉表征、通才视觉模型、通才多模态模型等最新研究进展。

张刚博士的报告主题为“视觉大模型技术和应用”。

针对视觉业务“需求广、应用杂”的现状,百度基于文心CV·大模型VIMER打造了一整套包括数据智能生产、大模型自迭代和小型化部署的端到端闭环方案,本次分享从半监督和多模态视角出发,重点介绍闭环方案在自动驾驶和文档智能场景的应用。

王凯博士的报告主题为“面向交通行业的佳都知行多模态大模型TransCore-M”。

面向交通行业应用场景对图像理解和逻辑推理能力的需求,我们研发了端到端的多模态大模型TransCore-M。TransCore-M 采用预训练和指令微调两种训练策略,来提升模型的多模态能力:在预训练阶段,冻结视觉模块(Visual Encoder)和语言模型(PCITransGPT),使用大量图文数据将图像和文本知识进行对齐;在指令微调阶段,构造多样性的文本和多模态联合数据,保持视觉模块冻结,将视觉对齐模块和语言模型进行全参微调,使得模型能够具备更丰富的多模态理解能力。TransCore-M在零样本场景下的各种常规视觉-语言任务中均有较好的表现,在多模态基准测试 MMBench和MME榜单中也取得了靠前的排名。

本次论坛为青年科学家们提供了宝贵的学术交流平台,为通用视觉大模型领域的研究进展提供了新的启示和思想碰撞。